HBM,生死局?

隨着chatGPT的爆火和AGI的繁榮,英偉達正在以前所未見的速度發展,這不但造就了GPU的繁榮,同時還讓扮演關鍵角色HBM熱度高居不下。

繼美光和SK Hynix在日前表示,今年的HBM產能自己售罄以後。美光和三星在近日也帶來了HBM新品,以期在這個蓬勃發展的市場佔有一席之地。其中,前者帶來了將用在英偉達GH200的之余,還表示將在2024 年 3 月帶來36 GB 12-Hi HBM3E 產品,後者則表示,公司發布的HBM3E 12H將性能和容量提高了 50% 以上。

由此可見,HBM的競爭愈演愈烈,HBM也成爲了決定AI芯片命運的關鍵。這也就是爲何Timothy Prickett Morgan認爲,誰掌控了HBM,就掌握了AI訓練。

以下爲Timothy Prickett Morgan的分享正文:

2024 年推動 Nvidia 數據中心 GPU 加速器發展的最重要因素是什么?

是即將推出的“Blackwell”B100 架構嗎?我們確信該架構將比當前的“Hopper”H100 及其胖內存弟弟 H200 提供性能飛躍?不。

是該公司有能力從代工合作夥伴台積電那裏拿回數百萬顆 H100 和 B100 GPU 芯片嗎?不,它不是。

是Nvidia AI Enterprise 軟件堆棧及其 CUDA 編程模型和數百個庫嗎?事實上,至少其中一些軟件(如果不是全部)是 AI 訓練和推理的事實上的標准。不過,又沒有。

雖然所有這些無疑都是巨大的優勢,並且是許多競爭對手都集中精力的優勢,但 Nvidia 在 2024 年推動其業務的最重要因素與金錢有關。具體來說:英偉達在 1 月份結束了 2024 財年,現金和銀行投資略低於 260 億美元,如果本財年按預期進行,收入將突破 1000 億美元,其中約佔 50% 以上如果以淨利潤的形式體現出來,那么即使在支付了稅款、龐大的研發業務以及公司的正常運營費用之後,它將爲其金庫增加約 500 億美元。

你可以用 750 億美元或更多的資金做很多事情,其中之一就是不必太擔心爲數據中心級 GPU 購买 HBM 堆棧 DRAM 內存所需的巨額資金。這種內存正在以相當好的速度變得更快、更密集(就每芯片千兆位而言)和更胖(FAT,就兆字節帶寬和千兆字節容量而言),但其改進速度並沒有達到人工智能加速器所需的速度。

隨着美光科技 (Micron Technology) 加入 SK 海力士 (SK Hynix) 和三星 (Samsung) 的供應商行列,HBM 的供應量有所改善,並且進給量和速度也隨之改善。我們強烈懷疑供應將無法滿足需求,HBM 內存的價格將隨着 HBM 在一定程度上推動的 GPU 加速器價格而繼續攀升。

AMD 擁有 57.8 億美元的現金和投資,沒有那么多闲置資金,盡管英特爾的銀行存款略高於 250 億美元,但它必須建立代工廠,這確實非常昂貴(按順序如今每次流行 150 億至 200 億美元)。因此,它也確實不能在 HBM 內存上揮霍。

對 Nvidia GPU 加速器業務有利的另一個因素是,在 GenAI 繁榮時期,客戶愿意爲數百、數千甚至數萬個數據中心 GPU 支付幾乎任何費用。我們認爲,2022 年 3 月宣布的原始“Hopper”H100 GPU的價格,特別是在 SXM 配置中,對於具有 80 GB HBM3 內存、速度爲 3.35 TB/秒的單個 H100,其價格超過 30,000 美元,我們不知道具有 96 GB 內存,速度爲 3.9 TB/秒的H100的費用,但我們能推測 Nvidia 對具有 141 GB HBM3E 內存、運行速度爲 4.8 TB/秒的 H200 設備的收費。H200 基於與 H100 完全相同的“Hopper”GPU,將內存容量提高了 76.3%,內存帶寬提高了 43.3%,H100 芯片的性能提高了 1.6 倍到 1.9 倍。考慮到額外的容量意味着需要更少的 GPU 並消耗更少的電量來針對靜態數據集訓練給定模型,我們認爲與原始 H100 相比,Nvidia 可以輕松地爲 H200 收取 1.6 倍到 1.9 倍的費用。

黃金法則:擁有黃金的人制定規則

我們並不是說 H200 在第二季度开始發貨時就會發生這種情況。(我們認爲英偉達除了財務數據外還談論日歷季度。)我們只是說這樣的舉動是有邏輯的。很大程度上取決於 AMD 對“Antares” Instinct MI300X GPU 加速器的收費,該加速器具有 192 GB 的 HBM3,運行速度爲 5.2 TB/秒。MI300X 具有更多的原始浮點和整數能力,HBM 容量比 Nvidia 的 H200 高 36.2%,帶寬比 H200 高 10.4%。

你可以用 Elon Musk 的最後一塊錢打賭,AMD 沒有心情做任何事,除了對 MI300X 收取盡可能多的費用,甚至有建議稱該公司正在努力升級到更胖、更快的 HBM3E內存領域,以保持對Nvidia的競爭。MI300 使用具有八高 DRAM 堆棧的 HBM3,MI300 中的內存控制器具有信號和帶寬容量,可以替換爲時鐘速度更快的十二高堆棧HBM3E 。這意味着容量增加了 50%,帶寬也可能增加了 25%。也就是說,每個 MI300X 具有 288 GB 的 HBM3E 容量和 6.5 TB/秒的帶寬。

據推測,這樣一個經過精心設計的 MI350X 芯片(我們可能會這樣稱呼它)在其峰值失敗次數中執行了相當大的實際工作量,甚至更多,就像 Nvidia 從 H100 跳躍到 H200 時所發生的那樣。

正是在這樣的背景下,我們想談談 HBM 領域發生的事情。我們將從 SK Hynix 开始,該公司展示了 16 個芯片高的 HBM3E 堆棧,每個堆棧提供 48 GB 的容量和 1.25 TB/秒的帶寬。MI300X 配備 8 個內存控制器,可實現 384 GB 內存和 9.6 TB/秒帶寬。

有了這些數字,您就不必將 CPU 作爲擴展內存控制器來處理大量工作負載。。。。

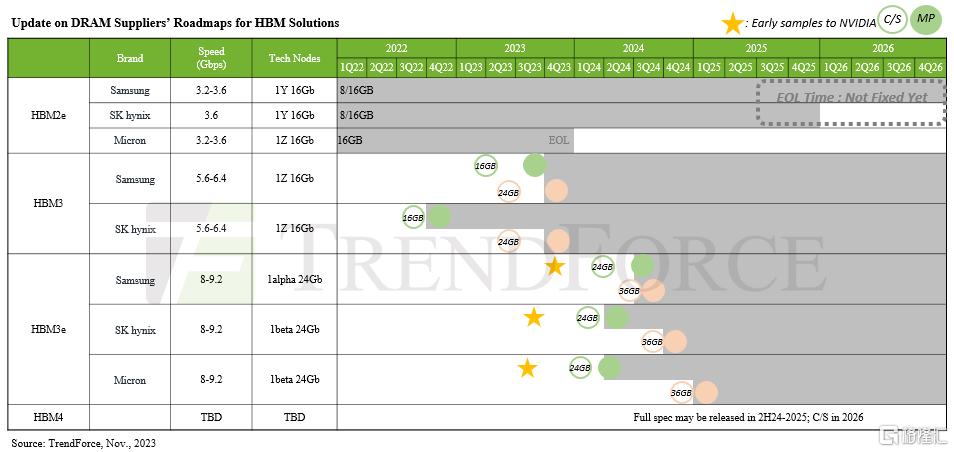

我們還沒有看到關於SK海力士十六高HBM3E內存的介紹,也不知道它什么時候上市。去年 8 月,SK 海力士展示了第五代 HBM 內存和第一代 HBM3E 內存,據稱每個堆棧可提供 1.15 TB/秒的帶寬。正如下面由 Trendforce 創建的 HBM 路线圖所示,我們的預期是提供 24 GB 和 36 GB 容量,這意味着 8 高堆棧和 12 高堆棧。

去年 8 月,Nvidia 顯然將成爲這些芯片的大客戶,並且有傳言稱 SK Hynix 的這款 24 GB HBM3E 內存將用於即將推出的“Blackwell”B100 GPU 加速器。如果是這樣,那么 Blackwell GPU 小芯片上的六個內存控制器將產生 144 GB 的容量,如果 B100 封裝按預期具有兩個 GPU 小芯片,則意味着最大容量爲 288 GB,帶寬爲 13.8 TB/秒。很難說收益率如何,可能只有 5/6 可用。也有可能 - 但我們希望不是 - B100 看起來不像一個 GPU,而是系統軟件的兩個 GPU(就像兩個芯片組 AMD“Arcturus”MI250X 所做的那樣,而不像 MI300X 那樣,後者有 8 個較小的 GPU 芯片組這加起來會帶來更多的魅力,看起來就像一個 GPU 到系統軟件)。我們將看看那裏會發生什么。

美光科技 (Micron Technology) 進入 HBM 領域較晚,但鑑於供應短缺和需求旺盛,該公司無疑在該領域最受歡迎,該公司今天表示,它正在开始生產其首款 HBM3E 內存,這是一種八高堆棧容量爲 24 GB,並補充說該內存是 H200 GPU 的一部分。我們去年 7 月介紹過的Micron HBM3E 變體的引腳運行速度爲 9.2 Gb/秒,每個堆棧提供 1.2 TB/秒的內存。美光還聲稱,其 HBM3E 內存的消耗量比“競爭產品”少 30%,想必它正在談論嚴格的 HBM3E 比較。

美光還表示,它已开始對其 12 高 36 GB HBM3E 變體進行送樣,其運行速度將超過 1.2 TB/秒。美光沒有透露比 1.2 TB/秒快多少。

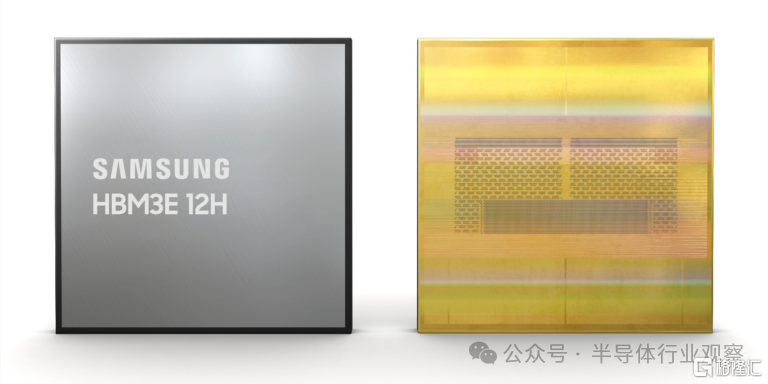

今天晚些時候,三星推出了十二高堆棧 HBM3E,這也是其第五代產品,該公司代號爲“Shinebolt”。

Shinebolt 取代了去年推出的“Icebolt”HBM3 內存。Icebolt 堆棧式 DRAM 內存爲容量爲 24 GB 的十二層堆棧提供 819 GB/秒的帶寬。Shinebolt HBM3E 在 36 GB 堆棧中提供 1.25 TB/秒的帶寬,就像 SK Hynix HBM3E 十二高堆棧一樣。

三星在公告中補充道:“用於AI應用時,預計與採用HBM3 8H相比,AI訓練的平均速度可提高34%,同時推理服務的並發用戶數可提升34%。”擴大11.5倍以上。” 三星指出,這是基於內部模擬,而不是實際的人工智能基准。

三星的 Shinebolt HBM3E 12H 現已提供樣品,預計在 6 月底前全面投產。

這些 12 高和 16 高的 HBM3E 堆棧幾乎是我們在 2026 年 HBM4 發布之前所擁有的。人們可能希望 HBM4 會在 2025 年出現,毫無疑問,我們面臨着推動路线圖升級的壓力,但這似乎不太可能。據猜測,HBM4 的內存接口將增加一倍,達到 2,048 位。HBM1 到 HBM3E 使用了 1,024 位內存接口,信號傳輸速度從 AMD 與 SK Hynix 設計並於 2013 年交付的初始 HBM 內存相比,已經從 1 Gb/秒增加到 9.2 Gb/秒。接口加倍將允許兩倍的速度。需要大量內存來掛起接口,並以一半的時鐘速度提供給定量的帶寬,並且隨着時鐘速度再次提升,帶寬會逐漸增加。或者。它們從一开始就以每引腳 9.2 Gb/秒的速度推出,我們只需支付以瓦爲單位的價格。

美光路线圖表示,HBM4 將提供 36 GB 和 64 GB 的容量,驅動速度爲 1.5 TB/秒到 2 TB/秒,因此看起來會是寬速和慢速、寬速和更快的混合,但在發布時不會完全滿足需求。談到帶寬。看起來,寬度加倍幾乎可以使容量和帶寬加倍。預計 HBM4 將具有十六層 DRAM 堆疊,僅此而已。

在 2026 年另一個宇宙的夢想世界中,HBM4 將擁有 2,048 位接口,類似於引腳上的 11.6 Gb/秒信號傳輸,具有 24 個高 DRAM 堆疊,具有 33.3% 密度的 DRAM 內存(4 GB 而不是 3 GB),因此,每個堆棧的速度約爲 3.15 TB/秒,每個堆棧的速度約爲 96 GB。哦,那我們就瘋狂吧。假設一個 GPU 復合體有十幾個小芯片,每個小芯片都有自己的 HBM4 內存控制器。這將爲每個 GPU 設備提供 37.8 TB/秒的聚合內存帶寬,以及每個設備 1,152 GB 的容量。

從這個角度來看,根據 Nvidia 的說法,一個 1750 億個參數的 GPT-3 模型需要 175 GB 的容量來進行推理,因此我們正在討論的理論 GPU 上的內存大小大概能夠處理 1.15 萬億個參數推理。對於 GPT-3 訓練,需要 2.5 TB 內存來加載數據語料庫。如果您的 Hoppers 具有 80 GB HBM3 內存,則需要 32 個 Hopper 才能完成這項工作。但我們的 32 台設備的容量將增加 14.4 倍,因此能夠加載相應更大的數據量。我們假設的設備上的帶寬也高出 11.3 倍。

請注意,我們沒有提及這十幾個 GPU 小芯片的失敗情況?在大多數情況下,以超過 80% 的利用率運行任何東西都非常棘手,特別是當它可能以不同的精度執行不同的操作時。我們想要的是讓觸發器與比特/秒的比率恢復正常。我們想要制造一台 12 缸發動機,它有足夠的噴油器來實際喂養野獸。

我們的猜測是,80 GB 的 H100 的 HBM3 內存約爲理想值的三分之一,帶寬也約爲理想值的三分之一。這是一種最大化 GPU 芯片銷售和收入的方法,正如 Nvidia 已經清楚地證明的那樣,但這並不是構建平衡的計算引擎的方法 - 就像英特爾在其 X86 芯片上放置一半的 DRAM 內存控制器並將其全部賣給我們一樣——兩個帶有中間倉部件的插座一直是數據中心通用計算的正確答案。我們還需要更多的內存容量和帶寬。

因此,如果使用這個概念性 Beast GPU 加速器將帶寬增加 11.3 倍,那么與原始 H100 相比,計算量可能只會增加 4 倍。在張量核心上,H100 在 FP64 精度下的額定速度爲 67 teraflops,在 FP8 精度(未使用稀疏性)下的額定速度爲 1.98 petaflops。因此,這個 TP100 GPU 復合體在 FP64 下的額定速度爲 268 teraflops,在 FP8 下的額定速度爲 7.92 petaflops,每個 GPU 小芯片的性能將是 H100 芯片性能的三分之一,並且可能是其大小的四分之一到五分之一,具體取決於使用的工藝技術。假設它是 TSMC 2N 或 Intel 14A 與真正的 H100 上使用的 TSMC 4N。畢竟,這是我們談論的 2026 年。

這就是我們想要寫的那種野獸,如果我們銀行裏有 260 億美元,並且未來還有 500 億美元以上的前景,這就是我們會做的。但是大量的 HBM 內存和計算引擎都塞滿了它。

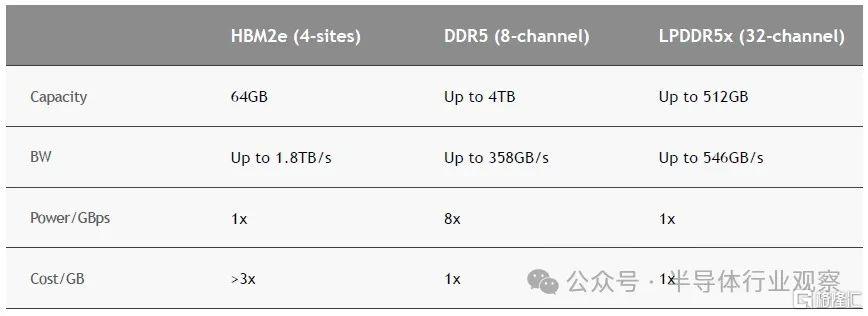

很難說這會花費多少錢。你不可能打電話給 Fry's Electronics 詢問 2026 年 HBM4 內存的市場價格是多少。一方面,Fry's 已經死了。另一方面,我們現在甚至無法很好地了解 GPU 和其他矩陣引擎制造商爲 HBM2e、HBM3 和 HBM3e 內存支付的費用。每個人都知道(或者認爲他們知道),HBM 內存和用於將內存鏈接到設備的任何中介層是現代人工智能訓練和推理引擎的兩個主要成本。(當然,混合使用片上 SRAM 和普通 DRAM 的人除外。)

在市場上,用於服務器的最大、最厚、最快的 256 GB DDR5 內存模塊在 4.8 GHz 下運行的價格約爲 18,000 美元,每 GB 約爲 70 美元。但僅可擴展至 32 GB 的更薄模塊每 GB 成本僅爲 35 美元。因此,HBM2e 的價格約爲每 GB 110 美元,“超過 3 倍”,如上面的 Nvidia 圖表所示。96 GB 的價格約爲 10,600 美元。很難說 HBM3 和 HBM3E 的提升在該設備的“市場價格”上可能值多少錢,但如果達到 HBM3 僅提升 25%,那么 H100 的市場價格約爲 30,000 美元80 GB 容量,HBM3 的價格爲 8,800 美元。轉向 96 GB HBM3E 可能會將內存成本提高到“市場價格”至 16,500 美元,因爲技術成本又增加了 25%,而且額外的 16 GB 內存和 H100 96 GB 的市場價格應約爲 37,700 美元。

聽到有關具有 141 GB 容量(由於某種原因不是 144 GB)的 H200 的價格的傳言將會很有趣。但如果這種內存價格分層成立——我們意識到這些都是瘋狂的估計——那么 141 GB 的 HBM3E 本身價值約爲 25,000 美元。但按照這樣的價格,H200 的“市場價格”約爲 41,000 美元。(注意:這不是我們認爲 Nvidia 爲 HBM3 和 HBM3E 內存支付的費用——這不是物料清單成本——而是分配給最終用戶的價格。)

我們認爲漲幅不會超過 25% 左右,因爲內存升級到 HBM3,然後再升級到 HBM3E 將推高內存價格,使其高於市場上傳聞的 Nvidia GPU 價格。

請記住,這只是一個思想實驗,旨在展示 HBM 內存定價如何控制 Nvidia 和 AMD 可以投入該領域的 GPU 數量,而不是相反。內存尾巴正在搖晃 GPU 的狗。內存容量和帶寬與 H200 的配合越來越緊密,如果 Nvidia 僅對額外的內存及其額外的速度收取象徵性的費用,那么不僅設備的實際效率會提高,而且性價比也會提高。但如果 Nvidia 只是對這些更強大的 H100 和 H200 進行定價,以便性能增益和內存增益達到平衡,那么花的錢就會少得多,而要花的錢就會多得多。

老實說,我們不知道 Nvidia 會做什么,也不知道 AMD 在 MI300 獲得 HBM3E 升級後會做什么。現在美光進入該領域的 HBM 供應商增加了 50%,而且 SK Hynix 和三星將產量提高了 2 倍,這是一個很大的數字,但相對於 GPU 和 GPU 的需求,市場上的 HBM 內存仍然只增加了 3 倍。他們的內存更大,可以說大於 3 倍。這不是一個可以降價的環境。在這種環境下,人們會提高更先進的計算引擎及其內存的價格,並繼續盡可能薄地擴展 HBM 內存。

這就是爲什么只要 Nvidia 平台繼續成爲首選,能夠支付高價購买 HBM 內存的人(即 Nvidia 聯合創始人兼首席執行官黃仁勳)就可以設定人工智能訓練的步伐和價格。

換而言之,對於GPU和HBM來說,他們面對的都是生死局。

原文鏈接

https://www.nextplatform.com/2024/02/27/he-who-can-pay-top-dollar-for-hbm-memory-controls-ai-training/

標題:HBM,生死局?

地址:https://www.iknowplus.com/post/84861.html